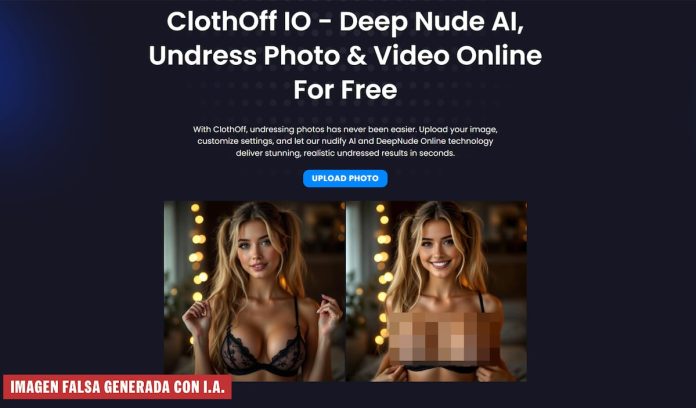

“Bastan tres clics para desvestir a alguien”, dicen los abogados de la menor. Estas aplicaciones de IA siguen creciendo sin control y añaden nuevas funciones para facilitar su uso

En octubre de 2023 unos jóvenes de un instituto de Nueva Jersey (EE UU) sacaron una foto del Instagram de una compañera y la pasaron por ClothOff, una aplicación que genera cuerpos desnudos con IA. Luego la enseñaron a compañeros y fue distribuida por Snapchat. Los sospechosos no fueron acusados penalmente por sus actos porque no quisieron hablar ni ceder sus dispositivos a las autoridades. La joven, que tenía entonces 14 años, temía volver a los pasillos del centro y vive en “perpetuo miedo” de que su imagen falsa reviva en internet. Ahora ha denunciado a ClothOff, la empresa presuntamente basada en Bielorrusia que está detrás de un grupo de apps con distintos nombres que desnudan con IA.

La demanda pretende “cerrar definitivamente las operaciones de ClothOff”, dice Brina Harden, miembro del Centro de Libertad de Medios y Acceso a la Información de la Universidad de Yale e integrante del equipo demandante junto a abogados colegiados. “Esta empresa existe únicamente para sacar provecho de la explotación sexual y el abuso facilitados por la inteligencia artificial”, añade.

La denuncia explica cómo el uso de estos servicios crece sin parar: “Webs como ClothOff no hacen más que ganar alcance y popularidad”, dice Harden, y añaden nuevas funciones como vídeos de las víctimas o colocar sus cuerpos en nuevas posturas sexuales. En su texto citan cifras para esta app de 27 millones de usuarios en los primeros meses de 2024 y la generación diaria de unas 200.000 imágenes. Su modelo de negocio es la suscripción o compra de créditos.

El caso español de ejemplo

La demanda cita el caso español del Almendralejo, que ocurrió justo en un mes antes. “Cuando nos pasó esto nadie sabía ni siquiera lo que era una deepfake”, dice Miriam Al Adib, ginecóloga y madre de una de las adolescentes afectadas en la ciudad extremeña. “Gracias a esa bomba mediática se tomaron en serio aquí las cosas porque al principio ni la policía sabía qué hacer con eso. Ahora al menos saben que se puede denunciar porque cuando nos atendieron el agente nos dijo que eso no era real, que era inteligencia artificial”, añade. Los jóvenes del Almendralejo fueron acusados de pornografía infantil e integridad moral. En EE UU, tienen desde mayo una ley contra la publicación de imágenes íntimas sin consentimiento, incluidas las generadas por IA.

“No sabía yo que se podía denunciar también directamente a la app”, dice Al Adib. El objetivo de la denuncia estadounidense es eliminar el acceso a esas apps en internet: “Esta demanda busca cerrar para siempre las operaciones de ClothOff. Si ganamos el caso, planeamos usar todos los medios posibles para hacer cumplir lo que ordene el tribunal, incluso pedir a los intermediarios que eliminen a ClothOff de sus plataformas”, explica Harden.

No será una tarea fácil. Hay cientos, miles de anuncios y opciones de bots que usan IA para estos fines. Hay miles de mensajes de bots en X con mensajes así en inglés: “No sé si esto es una genialidad o una locura, pero encontré una herramienta de IA que desnuda a la gente en las fotos. Es una pasada y da un poco de risa. Pruébala”. Y añaden al final, después del enlace, como una cierta advertencia: “Hazlo con cuidado”. Reddit y Telegram también ofrecen comentarios y acceso a este tipo de servicios, muchos vinculados a ClothOff, que compró al menos a 10 servicios similares con nombres como Undress AI Video, UndressHer, PornWorks, DeepNudeNow, Undress Love, DeepNudeAI, AI Porn o Nudify, según la demanda.

Desde el boom mediático de 2023 y de otros casos que han ido salpicando la actualidad, estas apps no han hecho más que mejorar, como todo el sector de la IA: mejores imágenes, más opciones, posibilidad de añadir vídeos. Con búsquedas simples, este periódico ha encontrado bots de Telegram que permiten gratis subir una foto y convertirla en cualquier imagen en una postura sexual. A pesar de los pequeños contratiempos (“Qué página de IA usas para editar la ropa en las fotos?, yo usaba ClothOff, pero ya la cerraron y no he podido encontrar otra similar”, pregunta un usuario anónimo en X), ClothOff sigue accesible con todo tipo de ofertas sofisticadas, como una API, que permite automatizar el proceso de creación de contenido pornográfico sin intervención humana.

El peligro de pornografía infantil y cualquier otro daño imaginable es obvia: “El acceso directo a la tecnología de ClothOff permite a los usuarios crear material de abuso sexual infantil y contenido íntimo no consentido, lo que da la posibilidad de generar contenidos más extremos y esquivar mejor los sistemas de detección. Ese acceso directo también ha dado lugar a la aparición de múltiples webs y aplicaciones imitadoras que facilitan crear el mismo tipo de material”, dice la denuncia.

Algunos lugares como California o Italia dicen haber impedido este año el acceso en sus territorios a algunas de estas aplicaciones. Por ahora parecen pequeñas victorias en una larga guerra. “ClothOff se diseñó para ser fácil de usar y totalmente anónimo”, dice Harden. “Basta con tres clics para generar imágenes desnudas, y la web no pide ningún tipo de verificación de edad”, añade. En las tendencias de Google puede verse el pico de otoño de 2023 en las búsquedas de ClothOff, pero las búsquedas por el nombre de la empresa o la expresión más genérica deepnude apenas han variado.

Un goteo constante

Los casos en España y en el mundo siguen ocurriendo. En julio, un joven de 17 años residente en Valencia fue detenido por desnudar fotos sacadas de redes de 16 compañeras de instituto y amigas víctimas había subido en su perfil de Instagram. El joven quería presumir de pericia informática y sacar algunos ingresos. Lo mismo le ocurrió a un joven de 15 años en Palma, que desnudó las imágenes de cinco compañeras. También pasó en febrero con un grupo de jóvenes en un instituto de Barcelona. Este mes de octubre, la policía japonesa ha detenido a un hombre de 31 años acusado de crear más de 20.000 imágenes de 262 mujeres, la mayoría famosas. Había ingresado unos 7.000 euros vendiendo acceso a esas imágenes falsas. En Japón ya había habido en abril una detención por venta de imágenes obscenas de mujeres.

En 2024, una investigación del Guardian permitió descubrir que los creadores de ClothOff eran dos personas residentes en Bielorrusia, Alaiksandr Babichau y Dasha Babicheva. Un exempleado del grupo de empresas detrás de ClothOff contó este verano a Der Spiegel que todos sus empleados trabajan desde países que pertenecieron a la antigua Unión Soviética. También detalló campañas de marketing en varios países de unos 150.000 euros en canales de Telegram, foros como Reddit o 4chan. Según documentos de la compañía que vio el Spiegel, el objetivo de la app son “hombres entre 16 y 35 años” con intereses en videojuegos, memes de internet, ideas extremistas de derechas, misoginia y Andrew Tate, un influencer misógino detenido que está siendo juzgado por violación en Rumanía.

En una muestra de cinismo, una de las preguntas en la web de ClothOff es si “es seguro usar ClothOff”. La respuesta solo tiene en cuenta la privacidad y seguridad de los usuarios, no de las víctimas que deben ver sus cuerpos tratados como mercancía: “Tus fotos se procesan de forma segura, sin guardarlas ni compartirlas, lo que la convierte en una de las plataformas más seguras para ‘desnudar’ fotos en línea. Nuestra herramienta deepnude online procesa tus archivos en la nube, sin almacenarlos ni compartirlos. Todo el contenido se borra automáticamente después de generarse”.

Fuente: El País